1.题目

Dual Path Embedding Learning for Speaker Verification with Triplet Attention

2.总结

本文提出了一种非常新颖的方法,通过两条路径来学习不同的特征,再让它们交互来得到更加全面的特征。用巧妙的设计模拟出了相似于RNN的状态,使得特征能够不断的积累。除此之外还提出了TA模块,即将C、F、T三种特征两两配对,经过注意力机制后再度融合,强调了三个维度间特征的相互依赖性。

基于上述创新之处,构建出了DPNet。且达到了交换两条路径上的特征,并使特征不断积累的效果。

3.研究目标

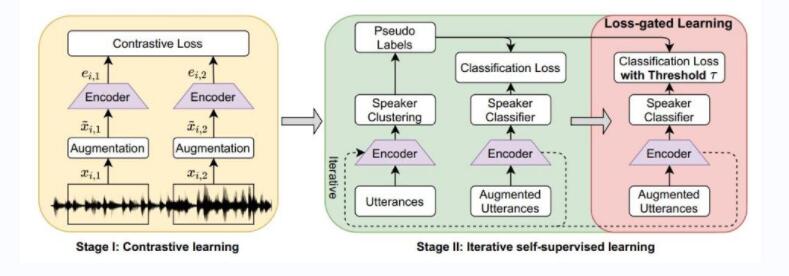

在说话人识别任务当中存在很多优秀的模型,但是人们对于掺杂了变种结构的混合模型的研究较少。故作者提出了一种新的混合变体网络结构。

4.使用方法

该网络中主要有两点创新,一个是双路径嵌入学习,另一个是提出了基于注意力机制的三特征融合TA模块。

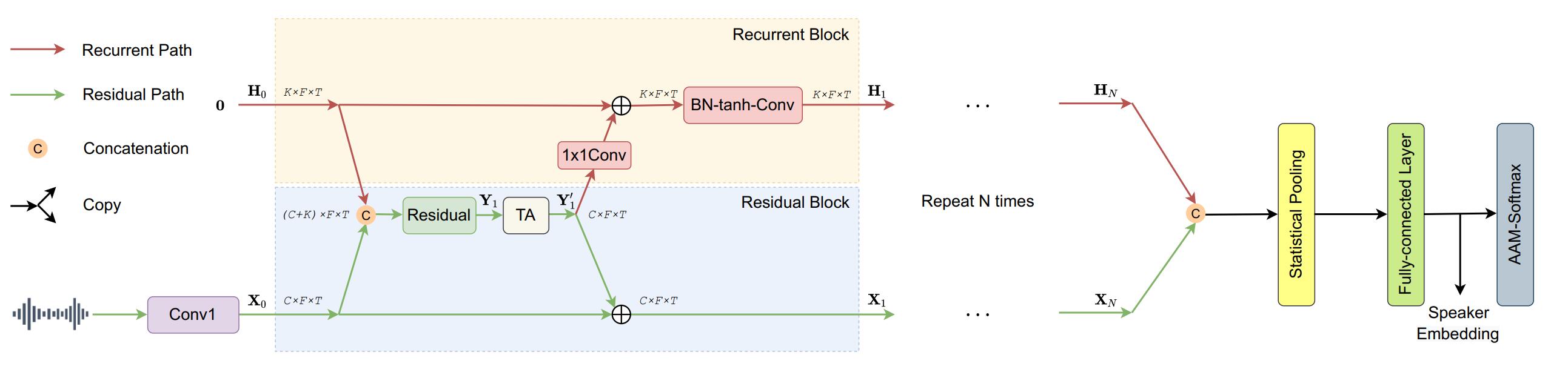

4.1 双路径嵌入学习

双路径为残差路径和循环路径,这两个路径所提取的特征都被用来交换信息以提取更好的特征。

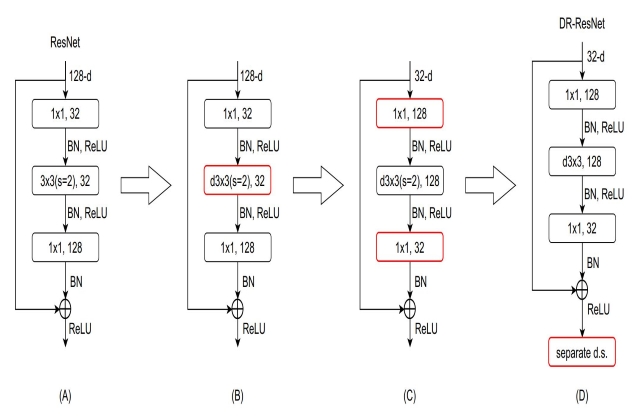

- 残差路径使用的是常用的ResNet

- 循环路径设计为给当前层提供的特征为先前网络层的特征沿着网络深度的积累(类似RNN,我想这也是它被称为循环路径的原因吧)

下面是DPNet的模型结构图

- 残差路径

残差路径即Residual Block,其实我觉得这个路径确切点可以叫做残差循环路径,因为在它也包含了和循环路径中相同的结构。不过作者可能更想突出它残差网络的部分,所以命名为残差路径。它主要使用ResNet网络和TA模块(TA后面会有讲到)

- 循环路径

循环路径即Recurrent Block。它主要用来积累每一层的特征、与残差路径交换信息、在时序上达到对特征的再利用和再挖掘。需要注意的是再循环路径中用到的第一个卷积为point-wise convolution(还记得上一篇论文里面提到的depth-wise convolution么?传送门)

这里不得不吐槽一下,这是一篇2022年声纹顶会interspeech上的文章,但是在写作时他却用了不合适的符号。他将循环路径中的两个卷积分别分为Conv1和Conv2,但是在模型图的残差路径中已经存在一个Conv1。这让我看的时候愣逼了半天,不过也有可能是我理解有问题吧,希望是我理解有问题。。。除此之外在本文Conclusions这一章,出现了把outperform错写成ourperform的低级错误,希望这也是我没看懂的单词吧,/(ㄒoㄒ)/~~

至此,我们可以看出DPNet的核心思想就是积累和交换两个路径上的特征,从而达到加强特征学习的效果。

4.2 Triplet Attention Module(TA)

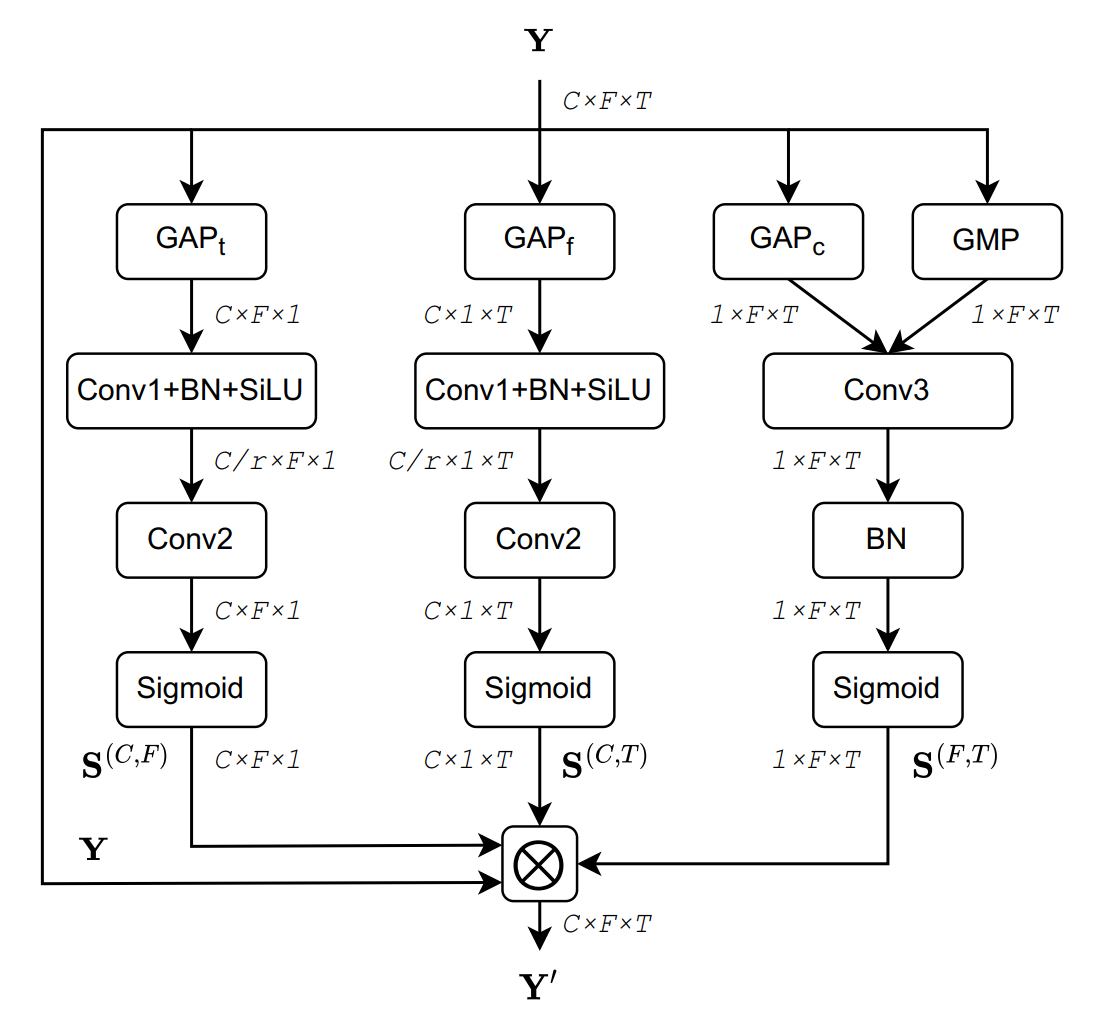

这里作者提出了一种新的注意力模块,如下图

它主要分为三个部分,分别提取了特征在CF、CT和FT上的特征,强调了特征之间的相互依赖性,最后再加以融合。

5.结论

- DPNet继承了残差网络和循环网络的优点,能够更好的实现对于特征的再利用和再发现

- DPNet的关键所在就是积累和交换两个路径下的特征

- 在CNN网络中沿着深度引入循环路径对于特征的再利用和再发现是非常有用的

6.额外笔记

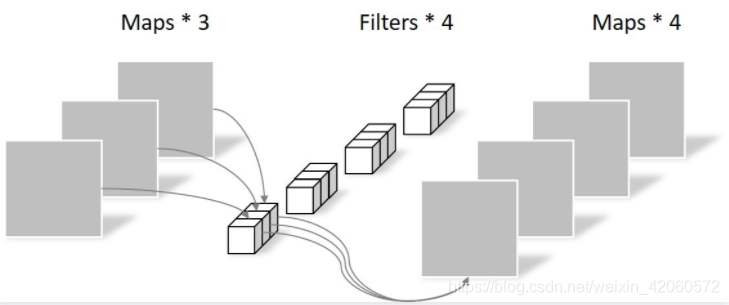

6.1 pointwise convolution

它与常规卷积非常相似,唯一不同的是它的卷积核大小为1*1*M,M为被卷积特征的通道数。如下图: